O mundo jurídico está passando por uma revolução tecnológica sem precedentes. A chegada da Inteligência Artificial generativa, com ferramentas como ChatGPT, está transformando a maneira como advogados e profissionais do direito realizam seu trabalho. Mas com grandes poderes vêm grandes responsabilidades. Como garantir que essa tecnologia seja usada de forma ética e eficaz no campo jurídico?

Neste artigo, exploramos as diretrizes desenvolvidas pela Federação Europeia de Advogados (FBE) sobre o uso de IA por profissionais jurídicos. Essas orientações surgiram após diversos casos polêmicos de uso inadequado de IA no meio jurídico e oferecem um roteiro valioso para advogados que desejam incorporar essas tecnologias em sua prática diária.

A FBE e sua Iniciativa sobre IA no Direito

A Federação Europeia de Advogados (FBE) é uma organização com mais de 30 anos de história, criada para apoiar profissionais jurídicos de todos os países membros do Conselho da Europa. Com mais de 200 membros e representando mais de um milhão de advogados, a FBE opera através de comissões paralelas, incluindo a Comissão de Novas Tecnologias, responsável por monitorar os avanços tecnológicos e seu impacto na prestação de serviços jurídicos.

Diante da rápida evolução da paisagem tecnológica e da dificuldade de muitos advogados em compreender a linguagem técnica associada à IA, a Comissão decidiu criar um documento simples e acessível que pudesse alcançar o maior número possível de profissionais em toda a Europa.

Por Que as Diretrizes Foram Criadas?

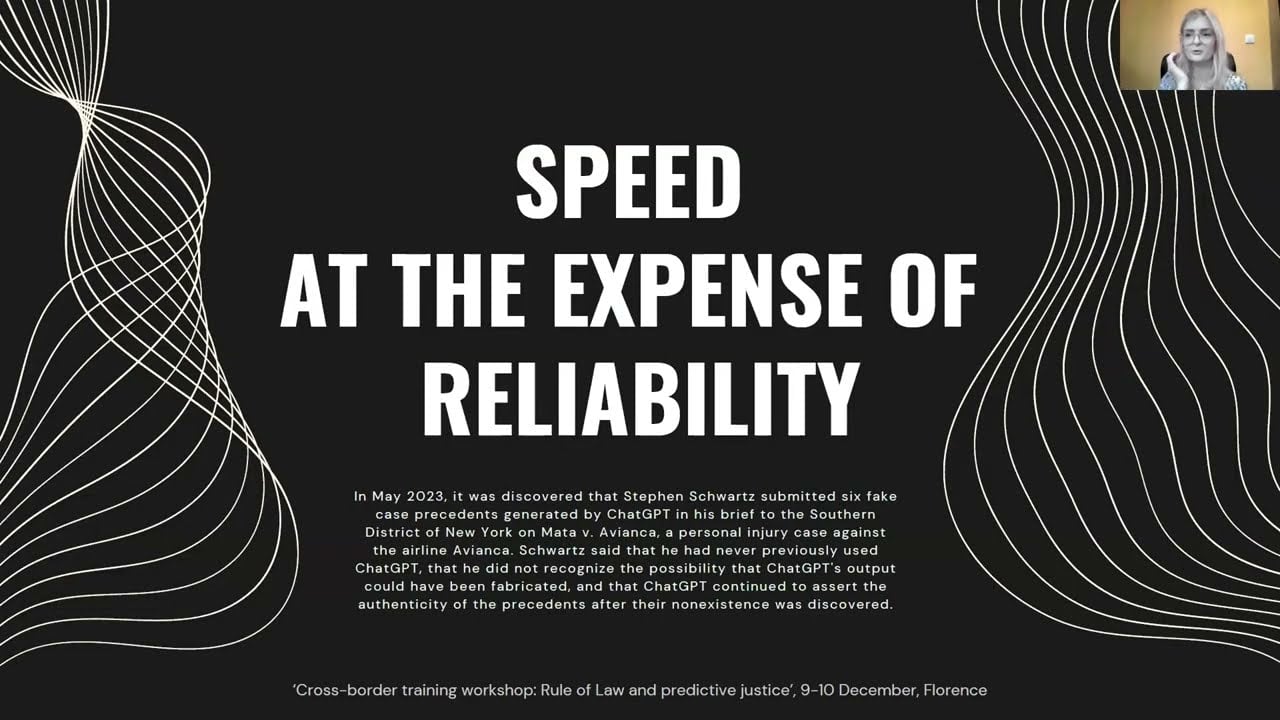

O gatilho para a criação das diretrizes foi uma série de equívocos iniciais no uso da IA generativa por advogados. Um caso emblemático ocorreu em maio de 2023, quando um advogado de Nova York, Steven Schwarz, utilizou o ChatGPT para produzir uma petição judicial que citava casos jurídicos completamente fictícios. O advogado admitiu não ter verificado a existência real dos precedentes mencionados, o que resultou em penalidades impostas pelo tribunal.

A FBE antecipou que casos semelhantes poderiam ocorrer na Europa em breve e decidiu agir preventivamente. O objetivo era garantir que a qualidade dos serviços jurídicos permanecesse mais importante que a velocidade de entrega dos resultados aos clientes.

A Primeira Edição das Diretrizes

A primeira edição das diretrizes da FBE sobre o uso de IA por advogados europeus foi lançada em junho de 2023, apenas um mês após o caso de Steven Schwarz. Após múltiplas discussões sobre como abordar o tema de maneira acessível, a comissão decidiu criar um relatório curto, com cerca de 20 páginas, mantendo-o o mais simples possível.

Este documento inicial propôs sete diretrizes de natureza geral para advogados seguirem, preenchendo uma lacuna na regulamentação existente tanto em nível legislativo quanto nos códigos de ética das associações de advogados nacionais ou locais.

Além das diretrizes propriamente ditas, o documento incluía esclarecimentos terminológicos e terminava com um chamado à ação para que diferentes partes interessadas se unissem ao esforço de criar métodos seguros e responsáveis para aplicar a IA generativa no meio jurídico.

O Impacto das Diretrizes

O documento teve um impacto surpreendentemente positivo, gerando milhares de downloads. Parte desse sucesso pode ser atribuído ao fato de a FBE ter sido uma das primeiras organizações a abordar essa questão específica para a comunidade jurídica.

Um fator crucial para esse alcance foi a tradução das diretrizes para diversos idiomas nacionais, incluindo italiano, polonês, espanhol, alemão, turco e português. Isso permitiu que as orientações chegassem a advogados que não acompanham regularmente redes internacionais ou documentos publicados em inglês.

Evolução do Cenário Tecnológico

Quando as diretrizes foram lançadas em junho de 2023, o mercado de IA generativa era dominado por ferramentas de propósito geral como ChatGPT, Bard (agora Gemini) do Google e Copilot da Microsoft. A FBE antecipou que mais ferramentas surgiriam, incluindo soluções específicas para o setor jurídico.

De fato, nos meses seguintes, testemunhou-se não apenas mais exemplos de uso indevido da IA por advogados, mas também por partes em processos judiciais e até mesmo por juízes. Simultaneamente, grandes provedores de ferramentas jurídicas como LexisNexis e Westlaw começaram a desenvolver suas próprias soluções baseadas em modelos de linguagem de grande escala.

A comissão passou a monitorar não apenas as novas possibilidades oferecidas por essas ferramentas, mas também sua confiabilidade, tentativas de limitar alucinações (informações fabricadas) e a implementação de soluções de verificação de fatos. Uma descoberta importante: mesmo com o avanço do mercado de tecnologia jurídica, os usuários finais ainda enfrentam incertezas sobre a confiabilidade dos resultados gerados por esses modelos.

A Segunda Edição das Diretrizes

Diante da evolução contínua da tecnologia e do cenário regulatório, a FBE lançou uma versão atualizada e ampliada das diretrizes em setembro de 2024. Um fator importante para essa atualização foi o desenvolvimento do Regulamento de IA da União Europeia (AI Act) e a Convenção do Conselho da Europa sobre IA.

No entanto, a comissão observou que a maior parte do trabalho realizado por profissionais jurídicos fora dos tribunais com IA generativa ainda está fora do escopo do AI Act. Além disso, há pouca legislação nacional que regule a prática jurídica ou o uso de tecnologia por profissionais do direito, e os códigos de ética profissional raramente abordam essas questões.

A nova versão das diretrizes incluiu mudanças significativas:

- Ajustes nas regras originais para acompanhar o crescente nível médio de conhecimento neste campo

- Inclusão de questões não abordadas na primeira versão, como o impacto sobre propriedade intelectual e meio ambiente

- Modificação da regra sobre informar clientes sobre o uso de IA, substituindo-a por uma orientação mais ampla sobre garantir transparência interna e externa

- Adição de referências às novas legislações relevantes

- Inclusão de exemplos práticos para tornar o documento mais útil para os leitores

Princípios Fundamentais para Advogados que Usam IA

Embora as diretrizes completas estejam disponíveis para consulta (e recomendamos fortemente sua leitura), podemos destacar alguns princípios fundamentais que advogados devem considerar ao usar IA generativa:

- Conhecimento e competência: Advogados devem entender as capacidades e limitações das ferramentas de IA que utilizam

- Supervisão humana: A responsabilidade final pelo trabalho produzido com assistência de IA permanece com o advogado

- Verificação de precisão: Todas as informações geradas por IA devem ser verificadas quanto à sua precisão e relevância

- Transparência: Garantir transparência adequada sobre o uso de IA, tanto internamente quanto com clientes

- Confidencialidade: Assegurar que o uso de ferramentas de IA não comprometa a confidencialidade dos dados dos clientes

- Considerações éticas: Avaliar os impactos éticos, ambientais e de propriedade intelectual do uso de IA

Aproveite o Potencial da IA Mantendo a Integridade Profissional

A IA generativa oferece oportunidades extraordinárias para modernizar a prática jurídica, aumentar a eficiência e melhorar o acesso à justiça. No entanto, seu uso responsável requer vigilância constante e compromisso com os princípios éticos fundamentais da profissão jurídica.

As diretrizes da FBE representam um esforço valioso para fornecer orientação prática em um momento de rápida transformação tecnológica. Ao seguir estas recomendações, advogados podem navegar com mais segurança nas águas desconhecidas da IA, aproveitando seus benefícios enquanto mitigam seus riscos.

Que tal começar a explorar essas possibilidades hoje mesmo? Baixe as diretrizes completas, discuta-as com seus colegas e comece a desenvolver políticas internas para o uso de IA em sua prática jurídica. O futuro da advocacia já está aqui – e com as ferramentas certas, você pode estar na vanguarda dessa transformação.

Perguntas Frequentes

Assista ao vídeo original

Este artigo foi baseado no vídeo abaixo. Se preferir, você pode assistir ao conteúdo original: