A maneira como as inteligências artificiais resolvem problemas está mudando drasticamente. Imagine o cérebro humano trabalhando em um problema complexo: nós não apenas seguimos um caminho linear de pensamento, mas exploramos diferentes possibilidades, retrocedemos quando encontramos becos sem saída e reavaliamos constantemente nossas opções. Uma nova abordagem chamada “Tree of Thoughts” (Árvore de Pensamentos) está finalmente trazendo essa capacidade para os grandes modelos de linguagem (LLMs), permitindo que eles “pensem” de forma mais parecida com humanos.

Desenvolvido por pesquisadores da Universidade de Princeton e do Google DeepMind, este método revolucionário está ampliando os horizontes do que a IA pode resolver, especialmente em problemas que exigem exploração, tentativa e erro, e pensamento não-linear. Vamos descobrir como essa tecnologia funciona e por que ela representa um avanço tão significativo no campo da inteligência artificial.

Entendendo o “Tree of Thoughts”: Além do Pensamento Linear

Para compreender verdadeiramente a revolução que o “Tree of Thoughts” representa, precisamos primeiro entender como os modelos de linguagem tradicionalmente abordam a resolução de problemas.

Da Resposta Direta ao Chain of Thought

Quando interagimos com modelos de linguagem como o GPT-4, normalmente usamos o que os pesquisadores chamam de “prompting de entrada-saída” – basicamente, fazemos uma pergunta e esperamos uma resposta direta. É simples, mas limitado para problemas complexos.

Um avanço significativo veio com o “Chain of Thought” (Cadeia de Pensamentos), que instrui o modelo a mostrar explicitamente seus passos intermediários de raciocínio antes de chegar à resposta final. Por exemplo, em vez de simplesmente pedir “escreva uma canção sobre um pássaro”, pedimos para planejar a estrutura, pensar sobre o tema e então criar a canção passo a passo.

Esta abordagem melhorou significativamente o desempenho dos modelos em tarefas complexas, possivelmente porque oferece ao modelo um “rascunho mental” para organizar seus pensamentos ou porque permite mais tempo de computação dedicado ao problema.

A Revolução da Árvore de Pensamentos

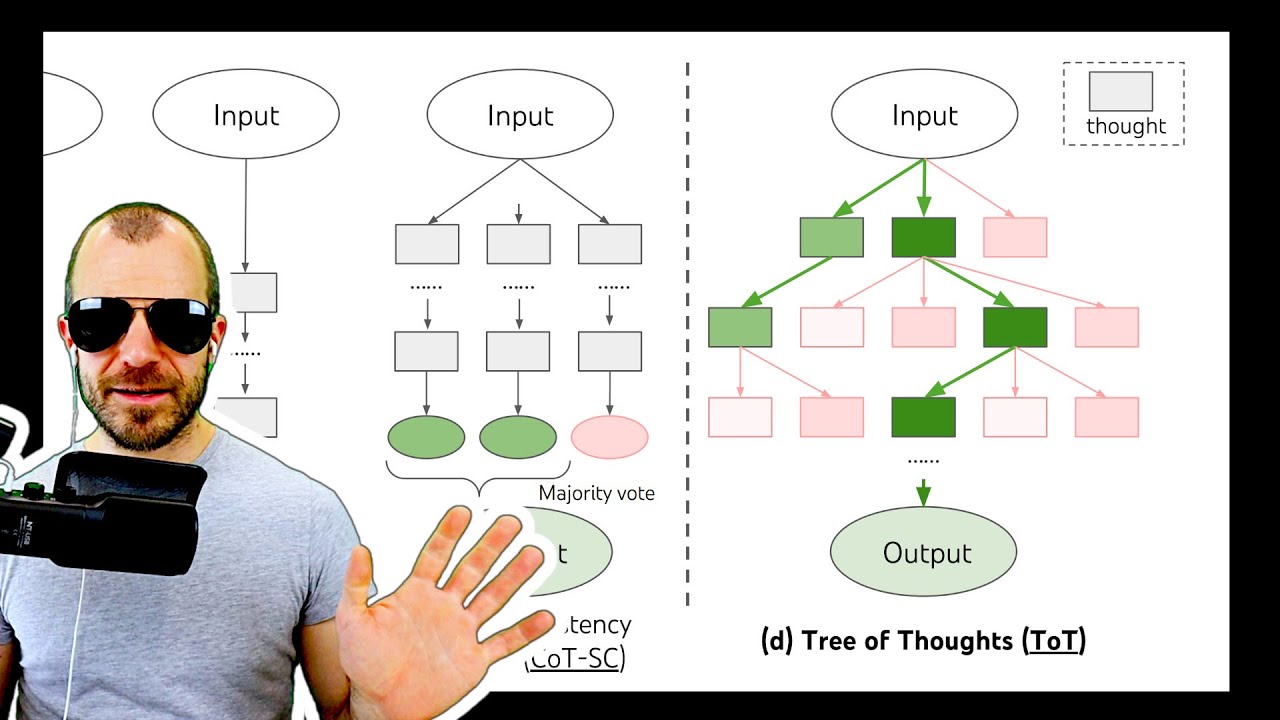

O “Tree of Thoughts” leva este conceito muito além, transformando o processo linear em uma estrutura de árvore onde múltiplos caminhos de pensamento podem ser explorados simultaneamente.

Funciona assim:

- O modelo gera múltiplos pensamentos iniciais para abordar um problema (por exemplo, três possíveis primeiros passos)

- Em seguida, o próprio modelo avalia cada um desses pensamentos, determinando quais parecem mais promissores

- Os caminhos menos promissores são podados (abandonados)

- Para os caminhos mais promissores, o modelo gera novos pensamentos subsequentes

- O processo continua, permitindo retrocesso quando necessário para explorar caminhos alternativos

Esta estrutura de pesquisa em árvore permite que o modelo explore diferentes estratégias de solução, abandone becos sem saída e encontre respostas que seriam impossíveis com abordagens lineares.

Como o Tree of Thoughts Funciona na Prática

O processo de implementação do Tree of Thoughts envolve dois componentes principais:

Gerador de Pensamentos

Este componente solicita ao modelo que gere um pensamento de cada vez – um passo intermediário na resolução do problema. Os pesquisadores usam dois métodos:

- Amostragem: O modelo é consultado várias vezes para gerar diferentes pensamentos possíveis (útil quando se deseja diversidade)

- Propostas: O modelo é solicitado a listar explicitamente múltiplas opções em uma única saída (melhor para respostas curtas e restritas)

Avaliador de Estados

Este componente crucial pede ao modelo que avalie a qualidade ou promissoriedade de cada pensamento gerado. Isto pode ser feito de duas maneiras:

- Valoração: Atribuindo uma pontuação ou classificação (como “bom”, “médio”, “ruim”) a cada pensamento

- Votação: Comparando diferentes pensamentos e selecionando o melhor entre eles

O que torna essa abordagem particularmente poderosa é que o mesmo modelo pode funcionar tanto como gerador quanto como avaliador. Os modelos de linguagem geralmente são melhores em avaliar se duas coisas combinam do que em gerar algo totalmente novo, tornando essa auto-crítica surpreendentemente eficaz.

Casos de Uso Impressionantes: Onde o Tree of Thoughts Brilha

Os pesquisadores avaliaram esta abordagem em três tarefas específicas que naturalmente se beneficiam de exploração e retrocesso:

O Jogo do 24

Neste desafio matemático, os jogadores recebem quatro números e devem criar uma expressão matemática que resulte em 24, usando cada número exatamente uma vez e operações básicas. Por exemplo, transformar os números 5, 7, 2 e 4 em uma expressão como (5×7)-(2×4)=24.

Esta tarefa se beneficia enormemente da capacidade de explorar diferentes combinações de operações e retroceder quando um caminho específico não leva a 24.

Escrita Criativa

Embora a melhoria tenha sido menos dramática neste caso, o Tree of Thoughts ainda mostrou vantagens na escrita criativa, onde diferentes inícios de história podem levar a narrativas completamente diferentes, e a capacidade de “retroceder” permite que o modelo explore vários caminhos narrativos.

Palavras Cruzadas em Miniatura

Aqui é onde o Tree of Thoughts realmente brilhou. Para resolver palavras cruzadas, é essencial conseguir preencher algumas palavras, perceber que uma escolha anterior pode ter sido incorreta, e retroceder para explorar diferentes possibilidades.

Usando este método, o modelo conseguiu resolver muito mais palavras cruzadas completas em comparação com abordagens lineares, demonstrando a eficácia do retrocesso e da exploração de múltiplos caminhos.

Implicações e Possibilidades Futuras

Este avanço abre caminho para um futuro onde a IA pode ser integrada com programação de maneiras novas e emocionantes:

- Algoritmos que usam LLMs em pontos estratégicos de sua execução

- Sistemas de IA que resolvem problemas complexos usando retrocesso e exploração

- Integração de modelos de linguagem em fluxos de trabalho de programação convencionais

Embora o paper original tenha usado prompts muito específicos para cada tipo de problema (tornando-o menos um “solucionador geral de problemas” e mais uma técnica especializada), o conceito é promissor para desenvolvimento futuro.

Você já pensou em como poderia integrar essa abordagem em seus próprios projetos de IA? Esta tecnologia está apenas começando, mas já podemos vislumbrar um futuro onde os modelos de linguagem trabalham lado a lado com algoritmos tradicionais para resolver problemas de maneiras totalmente novas.

O Futuro da Resolução de Problemas com IA

O Tree of Thoughts representa um passo importante na direção de modelos de linguagem que podem raciocinar mais como humanos – explorando possibilidades, reconhecendo becos sem saída e adaptando suas estratégias conforme avançam.

Embora ainda esteja em estágios iniciais, esta abordagem aponta para um futuro onde a IA não apenas responde a perguntas, mas participa ativamente no processo de resolução de problemas, trabalhando iterativamente através de desafios complexos com uma capacidade sem precedentes de autoavaliação e exploração.

Não deixe de explorar essas novas possibilidades em seus próprios projetos. A próxima geração de soluções de IA provavelmente combinará o melhor dos algoritmos estruturados com a flexibilidade dos grandes modelos de linguagem, criando sistemas de IA mais capazes e adaptáveis do que nunca.

Perguntas Frequentes

Assista ao vídeo original

Este artigo foi baseado no vídeo abaixo. Se preferir, você pode assistir ao conteúdo original: